Lesedauer: 9 Minuten

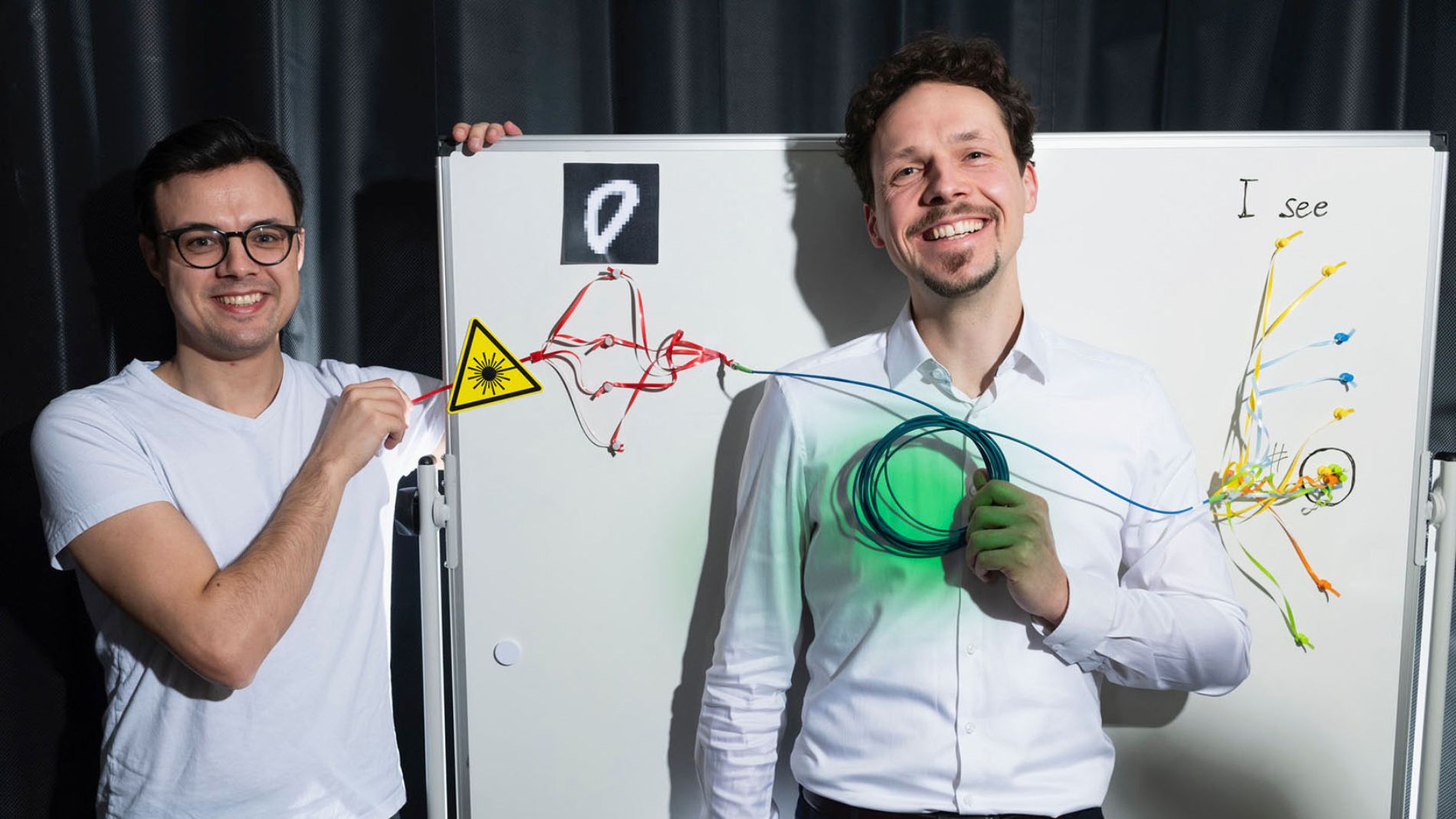

Dr. Mario Chemnitz ist Leiter der Abteilung Smart Photonics am Leibniz-Institut für Photonische Technologien und Juniorprofessor für Intelligente Photonische Systeme an der Friedrich-Schiller-Universität in Jena. Das Team hat eine neue Technologie entwickelt, die den hohen Energiebedarf von KI-Systemen senken könnte und die Datenverarbeitung beschleunigen würde. Als Inspiration dienen die neuronalen Netzwerke des menschlichen Gehirns.

Anna Moldenhauer: Sie haben sich gemeinsam mit Herrn Dr. Bennet Fischer vom Leibniz-Institut für Photonische Technologien e.V. (Leibniz-IPHT) und einem internationalen Team auf den Weg gemacht, um energieeffiziente Rechensysteme zu entwickeln – wie ist die Forschung entstanden?

Dr. Chemnitz: Mit Blick auf das Potenzial von neuronalen Netzwerken. Wir leben in einer Zeit, in der künstliche Intelligenz immer wichtiger und auch immer profunder wird. Sie transformiert unsere gesamte Gesellschaft. Das Forschungsfeld selbst ist bereits einige Jahrzehnte alt, die großen Errungenschaften sind in den letzten zehn bis zwanzig Jahren entstanden. Vor allem das Rechenkonzept des "Deep Learnings" war ausschlaggebend. Das bedeutet, wir sind inzwischen in der Lage, tiefe neuronale Netzwerke mathematisch zu modellieren und auch Trainingsmethoden zu finden, um diese zur Lösung komplexer Probleme zu befähigen. Wir können nun anfangen, diese tiefen Netzwerke für Aufgaben zu nutzen, die wir als intelligent bezeichnen würden. Aufgaben, bei denen man um die Ecke denken muss. Wie die Analyse einer großen Menge Datenpunkte in der Biologie – zehntausende Zellen auf einer kleinen Fläche in einem Blutbild. Um herauszufinden, welche gut geartet sind und welche nicht, müsste eine hoch ausgebildete Fachkraft an einem Mikroskopbild den Zellhaufen langwierig untersuchen, was je nach Bildaufnahme nicht einfach ist. Die neuronalen Netzwerke können so stark auf kleine Formate trainiert werden, dass sie diese Aufgabe zügig und mit sehr hoher Genauigkeit erledigen.

Das ist nur ein Anwendungsbeispiel, ein anderes wären Sprachmodelle. Für diese braucht es die Fähigkeit komplexe Muster zu erkennen, um auf das nächste Wort in einer Wortfolge schließen zu können. Die Anwendungsgebiete sind also sehr vielfältig. Das Problem der neuronalen Netzwerke ist ihr enorm hoher Energieverbrauch. Wir sind nicht weit davon entfernt, Atomkraftwerke für einen einzelnen Superrechner zu bauen, der lediglich ein großes Sprachmodell unterstützt. Microsoft hat kürzlich das stillgelegte US-Atomkraftwerk Three Mile Island übernommen, um Energie für ein neues Rechenzentrum zu generieren. Dafür wurde mit dem Versorger Constellation Energy ein Stromliefervertrag über 20 Jahre geschlossen. Die Internationale Energieagentur prognostiziert zudem, dass der Energieverbrauch von KI und Krypto-Währungen bis zum Jahr 2026 etwa dem gesamten Energieverbrauch Japans entsprechen soll – über 1.000 Terawattstunden.

Das ist so kritisch, dass inzwischen sogar die großen Chip-Hersteller zu bedenken geben, das die digitale Computerhardware diese Leistung langfristig nicht erbringen kann. Die künstliche Intelligenz wird langfristig Lösungen für viele Problemstellungen bieten, auch mit Blick auf den Klimaschutz. Aber der Weg dahin ist hochgradig schädlich. Dieses Dilemma inspiriert uns ForscherInnen neue Wege zu finden. Das ist ein hochinterdisziplinäres Feld mit ExpertInnen aus der Physik, aus den Ingenieurs- und Computerwissenschaften. Wir versuchen energieeffiziente KI Modelle und KI Hardware zu schaffen sowie das Konzept des neuronalen Rechnens zu erweitern. Mit unserer Erstpublikation haben wir einen kleinen Schritt gesetzt.

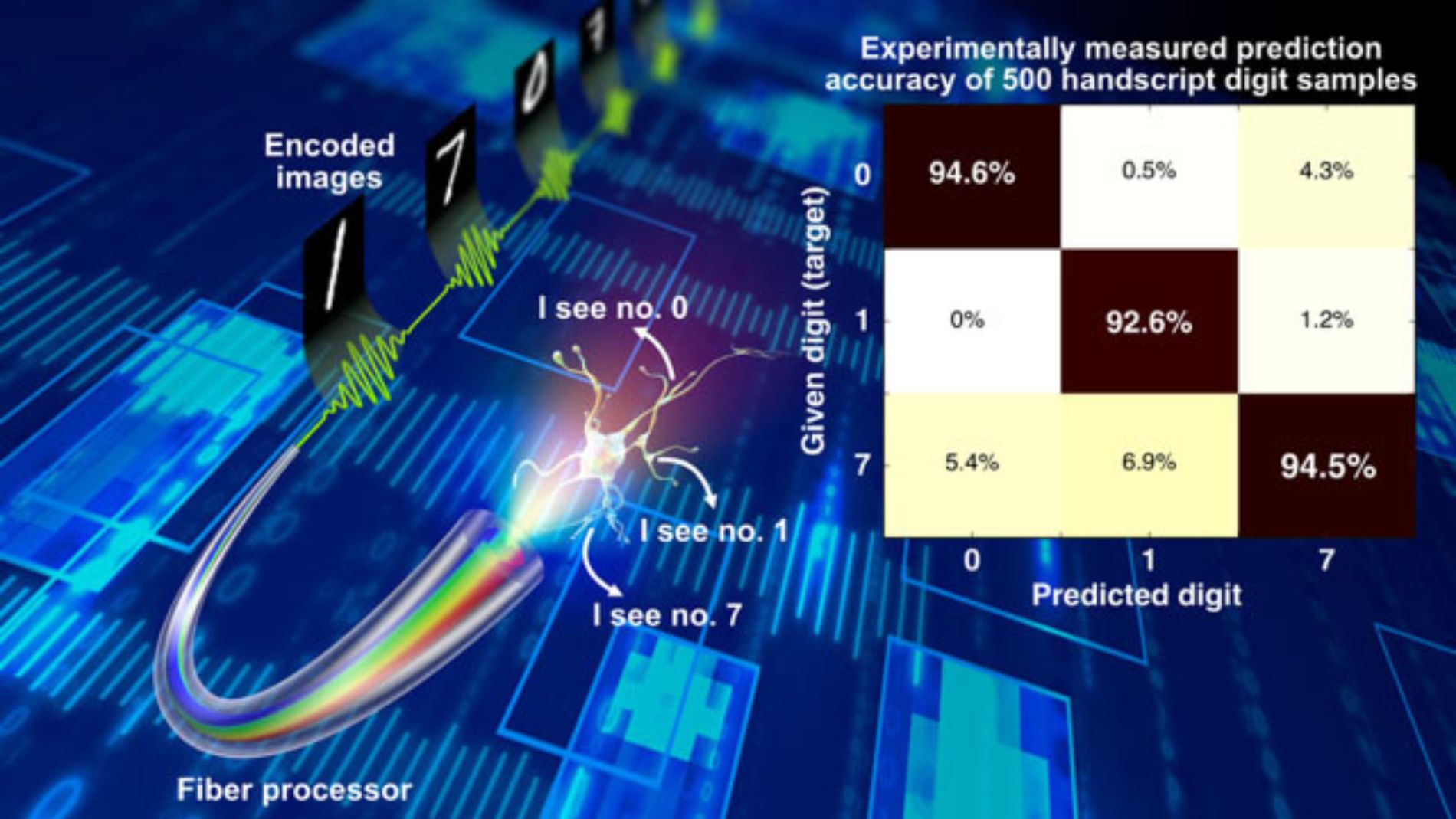

"Um den hohen Energiebedarf von KI-Systemen in Zukunft deutlich zu reduzieren, nutzt das Verfahren Licht für das neuronale Rechnen und orientiert sich dabei an den neuronalen Netzwerken des menschlichen Gehirns. Die Prozessoren sollen die im Licht enthaltenden Informationen erkennen und verarbeiten können" – soweit die Pressemeldung. Können Sie ein wenig aufschlüsseln, wie die Prozesse funktionieren?

Dr. Chemnitz: Wir reden über zwei verschiedene Anwendungsfelder, wenn es um das Rechnen mit Licht geht. Das erste Ende ist die digitale Rechenstruktur zu ersetzen, die wir aktuell in einem Computer haben. Wir arbeiten hin zu High End Prozessoren, die es ermöglichen, allgemeine künstliche Intelligenz einfach rechnen zu können. Anstelle der Grafikkarte für die wichtigen Vektor-Matrix-Multiplikationen, die in einem neuronalen Netzwerk ausschlaggebend sind, versuchen wir photonische Prozessoren oder optische Prozessoren zu entwickeln, die genau diese Vektor-Matrix-Multiplikation durchführen können. Das Schöne an Licht in diesem Kontext ist, dass es nahezu ohne Energieaufwand passiert, weil wir die Vektor-Matrix-Multiplikation mit natürlichen physikalischen Prozessen darstellen können. Das hört sich erst mal sehr komplex an, aber eigentlich reden wir hier über eine simple Lichtbeugung an datenbeladenen Strukturen. Die Energie steckt dann nur noch in der Lichtquelle und in der Detektion.

Unsere Hoffnung ist auch, dass wir die Rechenprozesse vermehrt kompakter gestalten und in einer gesamten Recheneinheit unterbringen können. Im zweiten und besten Fall könnten wir frei programmierbare, tiefe Netzwerke durch eine voll-optische Rechenarchitektur darstellen. Die Daten würden dann nicht mehr auf einer Festplatte liegen, sondern in dem Lichtfeld. Mit Hilfe der optischen neuronalen Netzwerke ließen sich die KI-Anwendungen somit energieeffizient beschleunigen. Wir denken dafür über sogenannte Edge Prozessoren nach. Das sind hochgradig energieeffiziente kleine Recheneinheiten, die in der entsprechenden Domäne arbeiten, wo die Information schon vorliegt.

Zum Beispiel in der Optik ist es die Information im Lichtfeld, auf deren Grundlage Kameras und Mikroskope funktionieren. Das heißt, Signalinformationen, die schon im optischen Bereich sind, müssen nicht mehr aufgenommen und durch den Supercomputer gejagt werden, der viel Energie verbraucht. Wie wäre es stattdessen, Kamerasysteme mit einer intelligenten Optik auszustatten, die nicht das Bild rekonstruiert, sondern uns direkt mitteilt, an welchem Bildbereich ein komplexes Gebäude oder ein Fehler in einer strukturellen Matrix zu finden ist? Diese Schwachstellen mit der optischen KI erkennen zu können, kann beispielsweise in der Architektur wichtig sein. Auch für eine Materialanalyse gibt es hier Chancen: Das Abscannen eines Metallträgers mit einem Lichtfeld reicht aus, um eine Inkonsistenz zu entdecken. Auch bräuchte es keine manuelle Bildbearbeitung mehr, da die intelligente Optik trainiert wäre, die passenden Filter selbstständig auszuwählen und zu kombinieren.

Wenn Sie in diesem Zusammenhang von Licht sprechen, was meinen Sie genau?

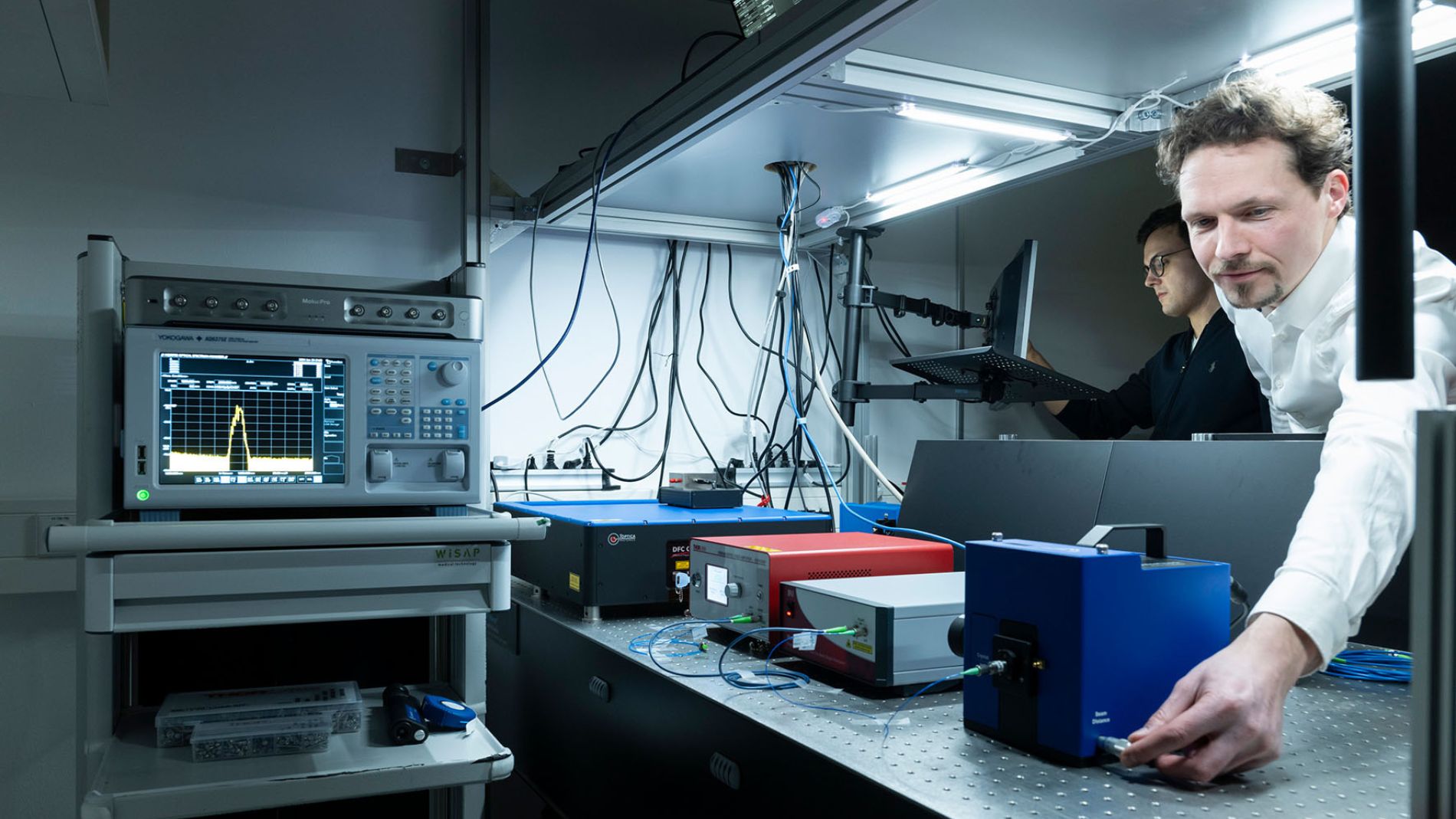

Dr. Chemnitz: In unserem System sind es gut durchdefinierte Laser, da gibt es keine Schwankungen und kein Rauschen. Wir wissen spektral zeitlich und räumlich exakt, wie das Lichtfeld aussieht. Parallel ist das System noch zu kostenaufwendig. Unser Ziel ist eine normale Weißlicht LED als Lichtquelle für ein tiefes optisches Netzwerk zu verwenden. Für diesen ersten Test, den wir aktuell vorstellen, besteht unser Netzwerk aus einer Schicht, es ist niedrigschwellig und hat eine begrenzte Anwendung. Auch andere Gruppen arbeiten daran, die Prozesse auf Einzelphotonen-Level zu bringen. Somit soll das Vektor-Matrixprodukt hergestellt werden, was dann im Endeffekt auch die strukturellen Informationen aus dem eingehenden Lichtfeld herausfiltern kann. Das ist schon sehr eindrucksvoll, da die Elektronik diese Leistung so schnell und effizient nie erbringen könnte.

Die Datenverarbeitung würde schneller werden, der Energieverbrauch der KI sinken – können Sie Prozentzahlen nennen, um die Kurven besser zu verstehen?

Dr. Chemnitz: Wir sprechen von wenigen Femtojoule (fJ) Energie pro Rechenoperation. Das sind 15 Stellen hinter dem Komma eines Joules. Man kann auch sagen, ein Millionstel von einem Milliardstel Teil. Also wirklich sehr wenig. Dadurch, dass die Lichtprozesse so intrinsisch energieeffizient sind, erfolgt die gesamte Rechnung eigentlich passiv, ohne dass noch mal Energie in das Rechenelement investiert werden muss. Mit unserer Methode erhoffen wir uns 1.000 bis 100.000 Mal weniger Energie pro Rechenoperation aus den optischen Komponenten im Vergleich zu den heutigen, hocheffizienten Grafikkarten von NVIDIA. Aktuell sind wir noch im Tausenderbereich und unsere Demonstration ist nicht am höchsten Ende der technischen Machbarkeit gelaufen. Wir arbeiten aktuell weiter daran, die Effizienz dieser Projekte zu steigern. Beispielsweise um eine Lernaufgabe im Bereich einer Nanosekunde Latenz durchführen zu können. Damit wären wir auch circa tausend Mal schneller als die digitalen Grafikkarten, die bislang verfügbar sind.

Wäre Ihre Technologie für potenziell energieeffiziente Rechenzentren geeignet, die somit auf eine umfangreiche elektronische Infrastruktur verzichten könnten?

Dr. Chemnitz: Soweit sind wir aktuell noch nicht. Ich könnte mir aber vorstellen, dass wir in 20 bis 30 Jahren durchaus kompetitive optische Vollsysteme haben. Was wir aktuell bereits nutzen können, sind Hybridlösungen, um die KI-Hardware zu beschleunigen. Es gibt diverse Start-ups, die sich auf die Herstellung von sogenannten Beschleuniger-Chips für die KI fokussieren. Diese Unternehmen setzen einen optischen Chip auf einen elektronischen digitalen Chip, um dann die Rechenoperationen, die schwer und energieaufwendig für die Elektronik sind, über diesen laufen zu lassen. Dazu gehört die Fourier Transformation, die werden viele LeserInnen aus der Bildbearbeitung und der Datenanalyse kennen. Das ist eine der Grundoperationen, um ein Bild zum Beispiel in verschiedene Frequenzanteile zu zerlegen, und dann hochfrequente von niedrigfrequenten Strukturen herauszufiltern.

Ebenfalls dazu gehören komplexe Vektor-Matrix-Multiplikationen. Die lässt man parallel auf dem optischen Chip ablaufen. Das ist auch visuell ganz interessant: Ein Faserbündel, das von einer Leuchtdiode kommt, wird in eine photonische Chipstruktur übersetzt, die direkt oberhalb des digitalen Chips sitzt. Diese Umsetzung an sich ist bereits ein Meisterwerk, denn die Elektronik und die Optik können nur schwer miteinander kommunizieren. Die Elektronik ist in der Regel etwas langsamer als die Optik, da gibt es einen großen technologischen Flaschenhals in der elektronischen zu optischen Signaltransferrate. Auch dieser wird in aktuellen Studien adressiert, wie mit Hilfe optimierter Modulations- und Detektionstechniken.

Foto: Sven Döring/ Leibniz-IPHT

Ihre Forschung könnte es ermöglichen, in einer umfangreichen elektronischen Infrastruktur auf tausende elektronische Bauteile zu verzichten. Birgt diese Reduktion auch Risiken, wie hinsichtlich der Fragilität?

Dr. Chemnitz: Das ist eine sehr gute Frage. Ich würde dagegenhalten: Was die Elektronik angeht, sind wir am Ende der Skalierbarkeit. Wir sind in den aktuellen Herstellungsprozessen bei circa fünf Nanometer Strukturgröße. Bald wird sicher einer der führenden Hersteller eine Strukturgröße von zwei Nanometer erreichen und wir wissen ehrlich gesagt nicht mehr, wie das physikalisch funktionieren soll. Auf einem typischen Wafer, das sind die runden Silizium-Plattformen, werden mittlerweile Trillionen von winzigen Transistoren aufgebracht. Diese Reduzierung in der Größe der elektronischen Bauteile birgt die Gefahr von Fehlerraten, so dass es bereits eine Industrie parallel gibt, die nur dafür geschaffen wurde, die fehlerhaften Chips auszusortieren. Eine große Hoffnung besteht daher in der Entwicklung von analoger Hardware, das heißt Rechensysteme, die nicht digital mit Nullen und Einsen rechnen, sondern im kontinuierlichen Zahlenraum. Leider haben alle analogen Rechensysteme Genauigkeitsprobleme. In der Optik stehen wir eher vor der Herausforderung, eine Million optische Transistoren auf eine solide Größe zu setzen, da die Wellenlängen von Licht und Elektronen unterschiedlich sind. Sprich, es gibt einen strukturellen Unterschied in der Wellenlänge der entsprechenden Teilchen, die sie zum Informationsprozess nutzen.

Die Hoffnung ist, dass wir es schaffen, die nötige Wellenleiterbreite zu erreichen und dabei die inhärenten positiven Eigenschaften von Photonen, das heißt von Lichtteilchen, nutzen zu können. Denn das bedeutet unendlich viele Lichtteilchen zur gleichen Zeit an einem Ort zusammenzubringen – mit Elektronen ist das nicht möglich. Die sogenannte "Parallelität von Licht" würde so effektiv genutzt werden, auch um die strukturellen Nachteile auf dem Wellenreiter kompensieren zu können. Dann stehen wir vor der zweiten Herausforderung, der Genauigkeit. Wenn die Messelektronik rauscht, kann das zu minimalen Abweichungen führen und die intelligente Entscheidungsfindung beeinflussen, die sich auf diese Werte stützt. Gerade für Börsen- und Finanzwerte ist es von großer Bedeutung, dass durch die Technologie keine Messfehler entstehen. Doch damit müssen wir umgehen lernen. Schließlich operiert unser Gehirn auch mit sehr rauschigen neuronalen Signalen.

Parallel zu den Herausforderungen wäre die Perspektive eine umweltfreundlichere KI sowie verbesserte Prozesse, wie für neue Methoden in der computerlosen Diagnostik, eine intelligentere Mikroskopie oder die digitalisierten Abläufe in der Baubranche. Welche Schritte sind nun wichtig, damit das keine Zukunftsmusik bleibt?

Dr. Chemnitz: Wir haben über die letzten dreißig Jahre herausgefunden, dass unsere aktuellen Technologien in der Optik die für die KI umfangreichen Berechnungen ermöglichen. Nun erfinden wir ein System nach dem nächsten für die Optimierung der Berechnungen von verschiedensten, einfachen Testaufgaben. Diese Projekte sind sehr spannend, aber die Frage am Ende ist: Kann die Energieeffizienz in einer Realanwendung gehalten werden?

Wenn das System komplett ist, bedeutet das eine ganze Peripherie, die mit Energie versorgt werden will – das Kamerasystem, eine Lichtquelle und viele Detektoren. Hilft es mir denn dann, wenn ich diese neue Struktur implementiere? Komme ich tatsächlich auf einen effektiven Energiegewinn? Wir reden bislang nur von dem Energiegewinn, den ein einzelner Rechenschritt birgt. Wenn wir mit der Energie rechnen würden, die wir aus der Steckdose beziehen, sieht das Gesamtbild schon realistischer aus. Wir sind aber zuversichtlich, dass wir diese Problematik lösen können, denn auch die Lichtquellen werden immer kompakter und effizienter. Ebenso können wir immer mehr neuronale Schichten parallel abdecken und desto energieeffizienter wird das System. Wichtig ist nun, dass wir es schaffen, Echtanwendungen mit realen Datenkomplexitäten zu demonstrieren.

Gibt es bereits aus der Industrie Anfragen für Ihre Forschung?

Dr. Chemnitz: Unsere Arbeit ist aktuell ein Novum im Feld. Wir haben eine abstraktere Denkweise eröffnet, wie man Informationsprozessierung verstehen kann. Daher ist die Industrie mit Anfragen noch zurückhaltend. Aber die Realisierungen, die bereits einige Jahre Forschungszeit hinter sich haben, wie die erwähnten KI-Beschleuniger, sind durchaus von der Industrie gefragt. Unter anderem baut Microsoft derzeit einen eigenen optischen Beschleuniger-Chip. Es gibt Start-ups, zum Beispiel "Light Matter" aus den USA, die einen hybriden Chip aus Glas entwickeln, der auf den elektronischen gesetzt wird. In Deutschland gibt es das Team um "Akhetonics", das eine komplette digitale Chiparchitektur volloptisch umsetzen will. Das heißt, alles, was der aktuelle Prozessor im Computer erledigt, soll zukünftig mit Licht passieren. Die Hoffnung ist, dass diese Systeme als genereller Prozessor auch für die KI einsetzbar sind. Es gibt zahlreiche junge Unternehmen, die versuchen, die Forschung in die Industrie zu überführen. Und genau das haben wir auch vor. Um die Entwicklung so weit zu bringen, dass wir uns tatsächlich kompetitiv aufstellen können, brauchen wir aber noch etwas Zeit.

Wie groß ist das weitere Potenzial der Analyse der neuronalen Netzwerke des menschlichen Gehirns für einen optimierten Umgang mit KI? Wo ist die Grenze?

Dr. Chemnitz: Wie hoch das Potenzial der KI eingeschätzt wird, hängt davon ab, wen Sie fragen. Für viele wäre es sicher ein Ziel, eine hochausgebildete menschliche Fachkraft durch KI zu ersetzen und eine KI zu schaffen, die sich für die Lösung der Aufgabenstellung im Prozess auch selbst prüft. Dieser Schritt wäre schon sehr weit, aber bedeutet noch keine Superintelligenz. Für diese müsste die Maschine Prozesse erledigen, für die der Mensch selbst nicht in der Lage ist. Meiner Ansicht nach ist vieles davon noch Träumerei.

Sehen Sie es als zukünftige Option, dass die KI mit dem Menschen im Team arbeitet, um sich selbst zu optimieren, auch hinsichtlich der Energieeffizienz?

Dr. Chemnitz: Das könnten wir durchaus bereits in den nächsten zehn Jahren mittels einer allgemeinen künstlichen Intelligenz erreichen. Mit der KI im Austausch für die Optimierung von Arbeitsabläufen und Prozessen zu sein, wäre ein enormer Boost für unsere allgemeine Arbeit. Kapazitäten ließen sich multiplizieren. Wenn wir derartige Systeme hätten, wäre die KI eine Art virtueller Kollege. Aber auch die virtuellen Kollegen machen Fehler, dass dürfen wir nicht vergessen. Und es bleibt die Frage, bis zu welchem Grad wir dieser virtuellen Unterstützung vertrauen können. Die Systeme, die aktuell von den Großunternehmen weltweit entwickelt werden, sind nicht mehr offen prüfbar, und die Frage nach der Datensicherheit müsste vorab verlässlich beantwortet werden.